原创 吞下AI药丸:你刷的视频、买的衣服,可能都是“数字幻觉”

财经摆渡人

精研出品

破浪前行,共探财富新局

大家好欢迎收看【古今财鉴】

今年底,一段胡彦斌和易梦玲的亲密热吻视频突然在网上传开。

评论区第一时间炸了锅,有人说“这肯定是AI合成的”,还有人翻出前两年的明星AI事件当证据。

结果没过两天,两人直接公开承认恋情,视频是真的。

但大家讨论的重点早就跑偏了现在看到明星的瓜,第一反应居然是“先怀疑是不是AI搞的鬼”。

这种条件反射不是凭空来的。

去年泰勒·斯威夫特被AI生成不雅视频那件事,全球粉丝气得联名抗议,平台删了好几天才清净。

从那以后,明星但凡有点争议内容,网友下意识就觉得“十有八九是AI造假”。

这种信任崩塌比单个事件本身更吓人。

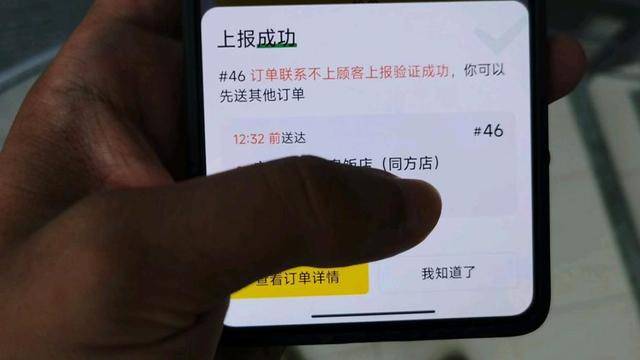

不光是明星恋情,连演员的脸都能被AI“借走”赚钱。

这两天温峥嵘发了条长文,说自己莫名其妙成了好几个直播间的“常驻主播”。

点进去一看,确实是她的脸在卖货,可本人压根没去过。

找商家对峙,对方居然说“这是AI套皮直播,跟你没关系”。

后来才发现,是之前合作的公司把她的直播切片授权出去了,现在产品出问题,就把锅甩给AI。

这种甩锅套路现在越来越常见。

之前看到一份报告,说去年到今年明星肖像权纠纷里,差不多三分之一的被告都拿“AI生成”当借口,比前一年多了两倍还多。

AI成了商家的“免罪金牌”,明星维权只能干着急。

体育圈的情况更糟。

全红婵几个月前就碰上过离谱事有人用她的AI合成声音和脸直播卖土鸡蛋,还伪造孙颖莎、王楚钦来“助力”,说什么“奥运冠军家乡风味”。

结果一查,那鸡蛋就是三无产品。

本来体育明星的“正能量形象”是优势,现在反倒成了AI造假的“香饽饽”。

听说今年上半年,国内至少二十多位奥运冠军被AI冒充带货,涉及的钱超五千万。

可维权成功的连两成都不到,主要是AI生成的证据链太难固定了。

运动员在赛场上拼尽全力,回头还得跟AI分身“打官司”,这算什么事啊。

从明星到普通人,AI造假如何无孔不入?

明星的事离咱们远,可日常生活里的AI造假更让人防不胜防。

年底短视频平台突然流行起“AI流浪汉整蛊”,有人把自家卧室照片用AI改成“藏着流浪汉”的样子,发给家人说“家里进贼了”。

结果真有人信了,大半夜报警,物业拿着棍子挨家挨户排查,最后发现是玩笑。

上海有个小区,光10月份就因为这种事报警12次。

警方后来出了《虚拟警情处理指南》,说故意传这种假信息可能要拘留。

但问题来了,怎么界定“故意”?朋友间开玩笑和恶意传播,界限模糊得很,执行起来全是难题。

更绝的是,连“反AI”的内容都开始被AI伪造了。

今年9月有段视频特别火,一个外国教授在课堂上暴跳如雷,说学生用ChatGPT写作业,痛骂“人类要失去独立思考能力了”。

评论区一片叫好,说“这才是清醒的教授”。

结果没过几天就被扒了整个视频都是AI生成的,教授是假的,课堂是假的,连愤怒的表情都是算法算出来的。

本来想不通,AI为啥要生成反AI的内容?后来发现,算法精明着呢。

它分析了这两年的舆情,知道70%以上的网民都担心AI削弱思考能力。

于是就顺着这个情绪,生成大家想看的“反AI内容”。

用反AI的壳,行AI渗透之实,这套路真是防不胜防。

外卖和电商里的AI造假更让人头疼。

商家用AI画“网红餐厅”的图,实际就是个脏乱小作坊,童装买家秀是AI生成的,孩子穿上直接小两号,毛绒玩具图片软乎乎的,到手硬得像砖头。

今年第三季度,全国外卖投诉里,差不多四成是因为“AI虚假宣传”。

去年“双11”的时候,有个电商平台查了一下,发现超200万件商品用的是AI主图,八成多都“过度美化”了。

买这种商品的人,退货率比真人实拍的高3倍。

现在网购看到好看的图,第一反应不是“想买”,是“这图是不是AI画的”,信任疲劳到这种地步,商家和消费者都难受。

当工具开始“反杀”,我们还能信什么?

AI造假不光骗活人,连已故名人都不放过。

英国演员西蒙佩吉今年8月发了篇长文,气得不行。

他说自己社交账号被灌了一堆AI视频,内容是“西蒙佩吉和罗宾·威廉姆斯对戏”。

罗宾·威廉姆斯都去世多少年了,这些视频里还让他说些低俗台词。

西蒙佩吉说得挺扎心:“AI正在消费逝者,践踏生者对逝者的尊重。”

联合国教科文组织有个报告,说全球已经有五千多位已故名人被AI“复活”,用来拍广告、演视频,其中六成多根本没经过家属同意。

技术发展到能“复活”人,却连最基本的尊重都做不到,这到底是进步还是退步?

《黑客帝国》里有个红蓝药丸的隐喻,红色药丸代表看清真相的痛苦,蓝色药丸代表沉浸虚拟的麻木。

现在AI生成内容泛滥,咱们每个人都在面对这个选择。

欧盟今年出了AI法案,要求AI内容必须加水印,违者最高罚2000万欧元。

国内也有类似的管理办法,说生成内容得标来源。

可实际呢?九成的短视频平台都没认真落实,水印小得跟蚂蚁似的,谁能看见?

想守护真实,光靠监管不够,还得有技术手段。

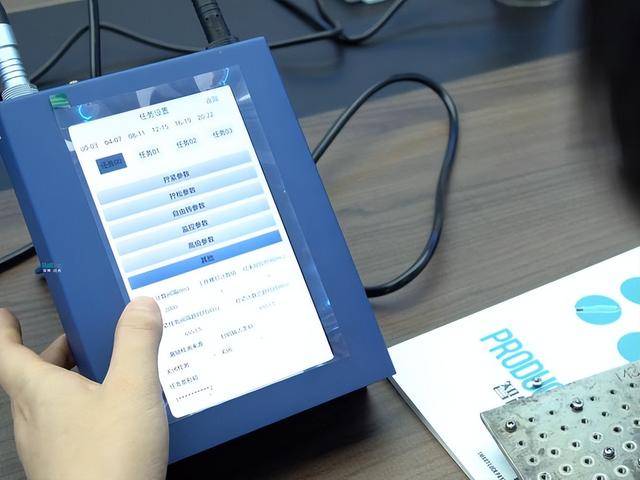

支付宝11月推了个“AI内容验真工具”,说能识别95%以上的Deepfake视频。

本来是好事,可普及率还不到10%。

大家要么不知道这工具,要么觉得“麻烦,懒得用”。

个人层面其实能做的也不少。

看到劲爆内容先看看发布账号靠不靠谱,别光看一个平台,多找几个地方交叉验证。

那些煽动情绪的,比如“教授怒砸电脑”这种,尤其要小心AI就喜欢利用咱们的焦虑和愤怒。

AI本身不是什么洪水猛兽。

它能帮我们写文案、修图片、做设计,提高效率是真的。

但当它被用来降低造假成本、模糊真实边界时,就成了侵蚀社会信任的“赛博菌子”。

从明星维权难到普通人被整蛊,从买东西货不对板到已故名人被冒犯,技术狂欢的背后,是真实感一点点流失。

企业要是能主动标清楚“这是AI生成的”,监管能把法律惩戒落到实处,咱们自己能多一分对“真实”的敏感和追问,情况可能会好很多。

毕竟,谁也不想在数字世界里当被算法牵着走的“傀儡”,咱们得做那个清醒的“掌舵人”,对吧?